How Much GPU Memory is Needed to Serve a Large Language Model (LLM)?

TL;DR

LLM 서빙에 필요한 GPU 메모리는

M = (P × 4B × Q) / 32 × 1.2공식으로 계산할 수 있습니다. 여기서 P는 파라미터 수, Q는 정밀도(16 or 32bit), 1.2는 추론 시 활성화 함수 등을 위한 20% 오버헤드입니다. 예를 들어 70B 파라미터 모델을 16-bit로 서빙하려면 약 168GB GPU 메모리가 필요하며, 이는 80GB A100 GPU 2대에 해당합니다. 프로덕션 환경에서 LLM 배포 시 하드웨어 리소스를 정확히 예측하는 것은 비용 최적화와 서비스 안정성 확보에 필수적입니다.

Key Takeaways

- 메모리 추정 공식 숙지:

M = (P × 4B × Q) / 32 × 1.2를 이해하면 모델 배포 전 필요한 GPU 리소스를 정확히 예측하여 인프라 비용을 최적화할 수 있습니다 - 정밀도 선택의 중요성: 16-bit precision을 사용하면 32-bit 대비 메모리 사용량을 절반으로 줄이면서도 대부분의 경우 충분한 정확도를 유지할 수 있습니다

- 20% 오버헤드는 필수: 추론 중 활성화 함수, 중간 결과물, KV 캐시 등을 위한 추가 메모리를 반드시 고려해야 실제 운영 환경에서 OOM 에러를 방지할 수 있습니다

- 멀티-GPU 전략 필요: 대규모 모델(70B+)은 단일 GPU로 서빙이 불가능하므로, 모델 병렬화(Model Parallelism)나 텐서 병렬화(Tensor Parallelism) 전략을 미리 계획해야 합니다

상세 내용

GPU 메모리 추정이 중요한 이유

LLM 인터뷰에서 가장 자주 등장하는 질문 중 하나는 "LLM 서빙에 얼마나 많은 GPU 메모리가 필요한가?"입니다. 이는 단순한 암기 문제가 아니라, 프로덕션 환경에서 모델의 배포 가능성과 확장성을 이해하고 있는지를 평가하는 핵심 지표입니다.

GPT, LLaMA 등의 대규모 언어 모델을 다룰 때, 필요한 GPU 메모리를 정확히 예측하는 능력은 필수적입니다. 7B 파라미터 모델이든 그 이상의 대규모 모델이든, 하드웨어 리소스를 올바르게 산정하는 것은 성공적인 배포의 핵심입니다.

GPU 메모리 추정 공식

LLM 서빙에 필요한 GPU 메모리는 다음 공식으로 계산할 수 있습니다:

공식 구성 요소:

- M: GPU 메모리 (Gigabytes)

- P: 모델의 파라미터 수

- 4B: 파라미터당 4바이트

- Q: 모델 로딩 시 사용하는 비트 수 (16-bit 또는 32-bit)

- 1.2: 20% 오버헤드

공식의 각 구성 요소 상세 분석

파라미터 수 (P)

모델의 크기를 나타내는 핵심 지표입니다. 예를 들어 LLaMA 70B 모델은 700억 개의 파라미터를 가지고 있으므로 P = 70,000,000,000이 됩니다. 모델 크기가 클수록 더 많은 메모리가 필요합니다.

파라미터당 바이트 (4B)

각 파라미터는 일반적으로 4바이트의 메모리를 차지합니다. 이는 부동소수점 연산에서 표준적으로 사용되는 32비트(4바이트) 정밀도를 기반으로 합니다. Half-precision(16비트)을 사용할 경우 이 값은 조정됩니다.

비트 정밀도 (Q)

- 32-bit (Full Precision): 가장 높은 정확도를 제공하지만 메모리 사용량이 큽니다

- 16-bit (Half Precision): 메모리 사용량을 절반으로 줄이면서도 대부분의 LLM 배포에서 충분한 정확도를 유지합니다

- 많은 LLM 배포에서 16-bit precision이 표준으로 사용되는 이유는 메모리 효율성과 정확도 사이의 최적 균형점이기 때문입니다

오버헤드 (1.2)

1.2 배수는 단순한 안전 버퍼가 아닙니다. 이는 추론 과정에서 실제로 필요한 추가 메모리를 고려한 것입니다:

- 활성화 함수(Activations): 각 레이어를 통과하며 생성되는 중간 결과물

- KV 캐시: Attention 메커니즘에서 사용되는 Key-Value 캐시

- 그래디언트 및 옵티마이저 상태: 파인튜닝 시 추가로 필요

- 기타 시스템 오버헤드: CUDA 컨텍스트, 드라이버 메모리 등

실전 계산 예시: LLaMA 70B 모델

70B 파라미터를 가진 LLaMA 모델을 16-bit precision으로 서빙하는 경우를 계산해보겠습니다:

이를 단순화하면:

결과: 약 168GB의 GPU 메모리가 필요합니다.

실무적 함의와 하드웨어 선택

이 계산은 단순한 이론이 아니라 실제 배포에서 중요한 의사결정 근거가 됩니다:

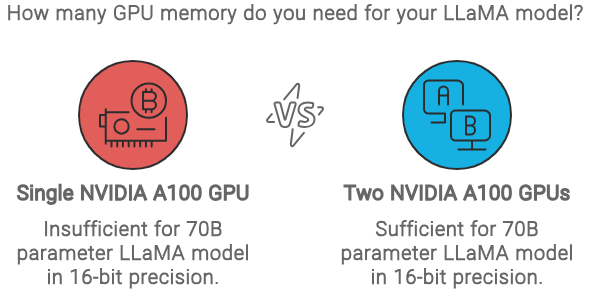

- 단일 GPU 한계: NVIDIA A100 80GB 단일 GPU로는 이 모델을 서빙할 수 없습니다

- 멀티-GPU 필요: 최소 80GB A100 GPU 2대가 필요합니다

- 대안적 접근:

- 모델 병렬화(Model Parallelism)를 통한 분산 배포

- 양자화(Quantization)를 통한 메모리 사용량 감소 (예: 8-bit, 4-bit)

- 효율적인 Attention 메커니즘 적용 (Flash Attention 등)

비용 최적화를 위한 고려사항

이 공식을 마스터하면:

- 인터뷰에서 자신감 있게 답변 가능

- 배포 전 정확한 하드웨어 요구사항 산정으로 예산 낭비 방지

- 확장 가능한 아키텍처 설계를 위한 기반 마련

- 프로덕션 환경에서 OOM 에러 등 치명적인 병목 현상 사전 방지

다음 LLM 배포를 계획할 때, 이 공식을 활용하여 필요한 GPU 메모리를 정확히 추정하고, 효율적이고 안정적인 서비스를 구축할 수 있을 것입니다.